sociale medier og søgemaskiner

Sociale medier og søgemaskiner udgør for mange de centrale indgange til internettet.

Sociale medier er der, vi bruger vores tid, mens søgemaskiner typisk er der, vi starter, hvis vi leder efter viden eller ressourcer. Det er derfor enormt vigtigt, at sociale medier og søgemaskiner handler forsvarligt og har deres brugeres interesse for øjet.

Det er dog ikke altid tilfældet, at sociale medier og søgemaskiner lever op til disse forventninger:

Fastholdelsesmekanismer, skadeligt og ulovligt indhold og mangel på moderation er alle eksempler på dette.

Klik dig ind på de forskellige emner og læs mere om de grundlæggende udfordringer med sociale medier og søgemaskiner, og hvad Digitalt Ansvar anbefaler i den sammenhæng.

Aldersverifikation er afgørende for at beskytte børn og unge mod skadeligt eller upassende indhold på sociale medier og andre digitale tjenester.

Hvad er den anbefalede skærmtid, og hvilke konsekvenser kan et stort skærmforbrug have for trivslen? Vi har samlet det, du skal vide om skærmtid.

Hvordan er børn og unge beskyttet på sociale medier, hvad kan vi gøre for at skabe mere sikkerhed, og hvilke krav er sociale medier underlagt?

Få viden om sociale mediers påvirkning og afhængighed. Lær at genkende fastholdelsesmekanismer, forstå tegnene og få råd til at bryde dårlige vaner.

Forældrekontrol på sociale medier er et af techs bedste bud på at sikre børn på sociale medier. Hvad er det, og hvorfor kan værktøjerne ikke stå alene?

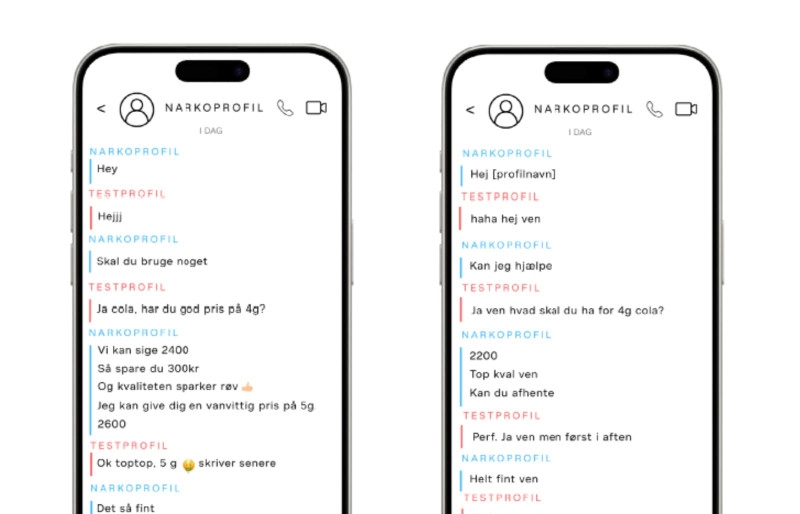

Narkotikasalg flytter i stigende grad over på sociale medier. Bliv klogere på fænomenet, herunder hvorfor platformene er så attraktive for stofsælgerne.

Analyser og undersøgelser relateret til sociale medier og søgemaskiner

Snapchats håndtering af salg af ulovlige stoffer på deres platform

Analysen viser, at Snapchat ikke har indført tilfredsstillende begrænsninger for åbenlyse narkorelaterede ord. Det er kritisabelt og ikke i overensstemmelse med de EU-forpligtelser, platformen har. Det er særligt kritisabelt set i lyset af, at Snapchat gentagende gange er blevet gjort opmærksom på, hvilken rolle platformen spiller i ulovligt narkotikasalg i Danmark.

Vold, magt og status: Bandemiljøets selviscenesættelse online

Analysen dykker ned i, hvordan danske rocker- og bandegrupperinger bruger Instagram, og hvad der motiverer unge til at interagere med bandekultur på Instagram og Telegram.

Søgemaskiners ansvar for udbredelsen af falske nøgenbilleder

Digitalt Ansvar har gentaget vores undersøgelse af søgemaskinernes ansvar for udbredelsen af manipuleret seksuelt materiale (også kendt som deepfake porno) fra 2024. Analysen viser, at Google fortsat leder brugere videre til materialet, men at Bing og DuckDuckGo har forbedret deres praksis væsentligt.

Snapchats håndtering af narkosalg på deres platform

Digitalt Ansvar har undersøgt Snapchats håndtering af brugeranmeldelser, der drejer sig om narkosalg. Den konkluderer, at Snapchat ikke i tilstrækkelig grad reagerer på brugeranmeldelser af de ulovlige profiler.

Et eksperiment om at nedsætte danskernes TikTok-forbrug

Digitalt Ansvar har i samarbejde med Norlys undersøgt, om det er muligt for 129 danskere at sænke deres forbrug af TikTok. Undersøgelsen viser, hvor stærkt et greb sociale medier har om os, og at ansvaret for et sundt skærmforbrug derfor ikke kan placeres på den enkelte alene.

Anmeldelser af indhold til de sociale medier

Digitalt Ansvar har undersøgt omfanget af danskere, der anmelder ulovligt indhold på sociale medier, samt deres kendskab til muligheder for anmeldelse. Undersøgelsen viser bl.a., at hver fjerde ikke anmelder ulovligt indhold, når de støder på det.

Forældrekontrol i en dansk kontekst

Digitalt Ansvar har undersøgt danske forældres brug af og holdninger til forældrekontrol på de sociale medier. Undersøgelsen viser, at forældrekontrol ikke nødvendigvis harmonerer godt med danske forældres opdragelsesstil, hvor tillid og dialog er centralt.

Ulovlig deling på Telegram

Digitalt Ansvar har kortlagt det danske marked for køb og salg af intimt materiale uden samtykke på platformen Telegram samt antallet af danske ofre. Tallene vidner om, at manglende regulering har muliggjort et voksende kommercielt marked for ulovligt intimt materiale.

Instagrams forældrekontrol

Digitalt Ansvar har kortlagt Instagrams nye teenageprofiler og de udvidede forældrekontrol-funktioner, der skal beskytte unge brugere og give forældre tryghed. Konklusionen viser, at tiltagene er nemme at omgå.

Instagrams selvskadebedrag

Undersøgelsen viser, at Instagram stadig ikke fjerner voldsomt selvskadeindhold og stik imod deres egen udmelding fravælger at bruge kunstig intelligens til automatisk at fjerne indholdet.

Bag om Google og Bings anmeldelsessystem

Vi har undersøgt Google Search og Microsoft Bings anmeldelsessystem ved at indgive en række anmeldelser af søgeresultater, der henviser til hjemmesider med manipuleret seksuelt materiale – også kendt som ’deepfake porno’.

Google og Bing: Reklamesøjle for falske nøgenbilleder

En undersøgelse af søgemaskinernes ansvar for spredningen af manipuleret seksuelt materiale - også kendt som 'deepfake porno'.

TikToks mørke universer

En undersøgelse af, hvad TikTok eksponerer brugere, med interesse for selvskade, selvmord og psykisk lidelse, for på deres Til dig-side.